Claude Opus 4.7 深度解析:编程智能体的“新巅峰”与隐藏的成本变动

2026年4月16日,Anthropic 正式发布了其目前最强大的公测模型 —— Claude Opus 4.7。这次更新不仅是版本号的递增,更是针对“编程智能体(Coding Agents)”的一次精准进化。

虽然在 Anthropic 的产品序列中,Opus 4.7 的性能仍排在尚未完全公开的 Claude Mythos Preview(Project Glasswing)之下,但对于绝大多数开发者和企业用户来说,Opus 4.7 已经是目前市场上能触达到的“性能天花板”。

核心升级:性能指标的跨越式增长

根据 Anthropic 及合作伙伴提供的测试数据,Claude Opus 4.7 在多项核心基准测试中表现惊人:

- SWE-bench Verified: 评分从 4.6 版本的 80.8% 提升至 87.6%。

- CursorBench: 评分从 58% 飙升至 70%。

- 诚实度(Honesty Rate): 达到 92%,这意味着模型的幻觉进一步减少,更加接近人类的逻辑严谨性。

实际应用场景中,CodeRabbit 报告称,该模型在处理复杂 PR(拉取请求)时的召回率提升了 10% 以上,而 Rakuten 则反馈其生产任务的解决效率提升了 3 倍。

改变游戏规则的四个关键变化

1. 行为逻辑:引入“自验证”机制

Opus 4.7 不再只是盲目地输出代码,它学会了在报告任务完成前检查自己的工作。在代理式编程上下文中,这意味着模型会自动编写测试、运行测试并修复失败项,然后再将结果提交。这种“先思考、再验证、后交付”的行为显著降低了代理产生误导性输出的概率。

2. 全新努力级别:xhigh

在原有的 low、medium、high、max 基础上,新增了 xhigh 级别。Anthropic 建议在编程和复杂代理任务中首选 xhigh。实验表明,Opus 4.7 在 low 级别下的表现已基本等同于 Opus 4.6 的 medium 级别。

3. 视觉能力:3.3倍分辨率提升

Opus 4.7 的最大图像处理分辨率从 1.15 MP 提升到了 3.75 MP。在 XBOW Visual Acuity(计算机使用屏幕截图任务)基准测试中,其得分从 54.5% 跃升至 98.5%。现在,模型识别像素坐标更加精准,不再需要像 4.6 版本那样进行比例缩放修正。

4. 任务预算(Task Budgets)

新增公共测试版功能,允许开发者为整个代理循环设置 Token 目标。模型会看到剩余预算的倒计时,并在预算耗尽前优雅地结束任务。

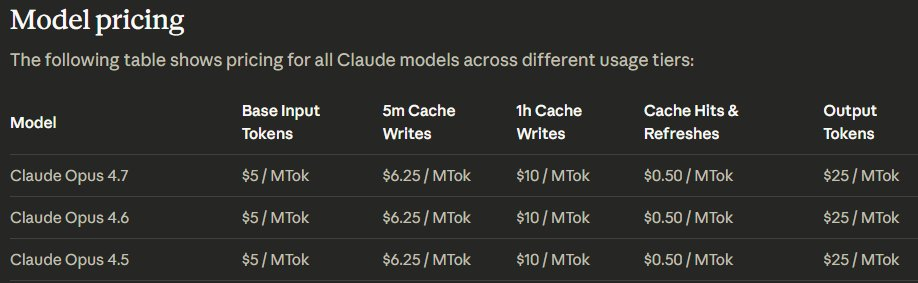

“价格不变”下的隐藏成本

虽然 API 的标价依然维持在每百万输入 Token $5 / 输出 $25,但开发者必须注意一个关键点:Tokenizer(分词器)变了。

新的分词器在处理相同文本时,产生的 Token 数量比旧版本多出 1.0x 到 1.35x。这意味着:

- 多语言文本(如中日韩文):Token 数可能增加 20%-35%。

- 结构化数据(JSON/XML):Token 数会有中等程度的增加。

- 英文散文:影响较小(约 5%)。

换句话说,对于特定内容,即使单价没变,你的实际账单可能会增加 35%。

迁移注意事项与不足之处

并非所有指标都在提升。在 BrowseComp(多步骤网页研究)测试中,Opus 4.7 出现了小幅回落(从 83.7% 降至 79.3%),表现略逊于 GPT-5.4。此外,在命令行任务执行(Terminal-Bench 2.0)方面,它也落后于 GPT-5.4 约 5.7 个百分点。

开发者迁移 Checklist:

- 分词器适配:不要沿用旧的 Token 估算模型。

- Prefill 限制:Opus 4.7 不再支持预填充助手消息(Prefilling assistant messages),否则会返回 400 错误。

- 输出限制:单次响应输出限制为 128K Token,上下文窗口依然为 1M。

结语

Claude Opus 4.7 的发布让编程智能体迈向了生产力的新高度。尽管存在分词器带来的变相涨价,但其强大的自验证能力和视觉精度提升,使其成为了目前市场上最受开发者青睐的模型之一。随着 Google Antigravity 等竞争对手仍在追赶,Anthropic 再次证明了自己在 AI 编程领域的领先地位。