2026 AI 评测指南:Claude Opus 4.7 的性能飞跃与基准测试的局限性

引言:2026 年的 AI 军备竞赛

随着 2026 年 4 月 Claude Opus 4.7 的正式发布,人工智能领域再次迎来了一个关键节点。在基准测试(Benchmarks)逐渐趋于饱和、生产环境挑战日益复杂的今天,如何客观评价一个 AI 模型的优劣?这不仅关乎分数的比拼,更关乎在真实软件工程中的落地能力。

Claude Opus 4.7:编程代理的新高峰

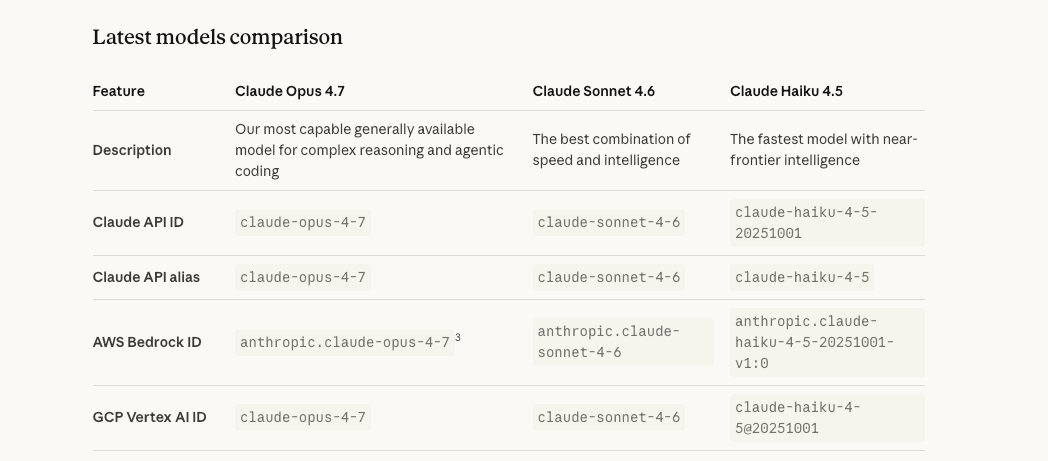

Anthropic 推出的 Claude Opus 4.7 作为 Opus 4.6 的直接升级版,被定位为目前最强大的通用型模型。尽管其性能仍略低于受限发布的 Claude Mythos Preview(Project Glasswing),但对于广大开发者而言,Opus 4.7 已经是目前可用的“性能天花板”。

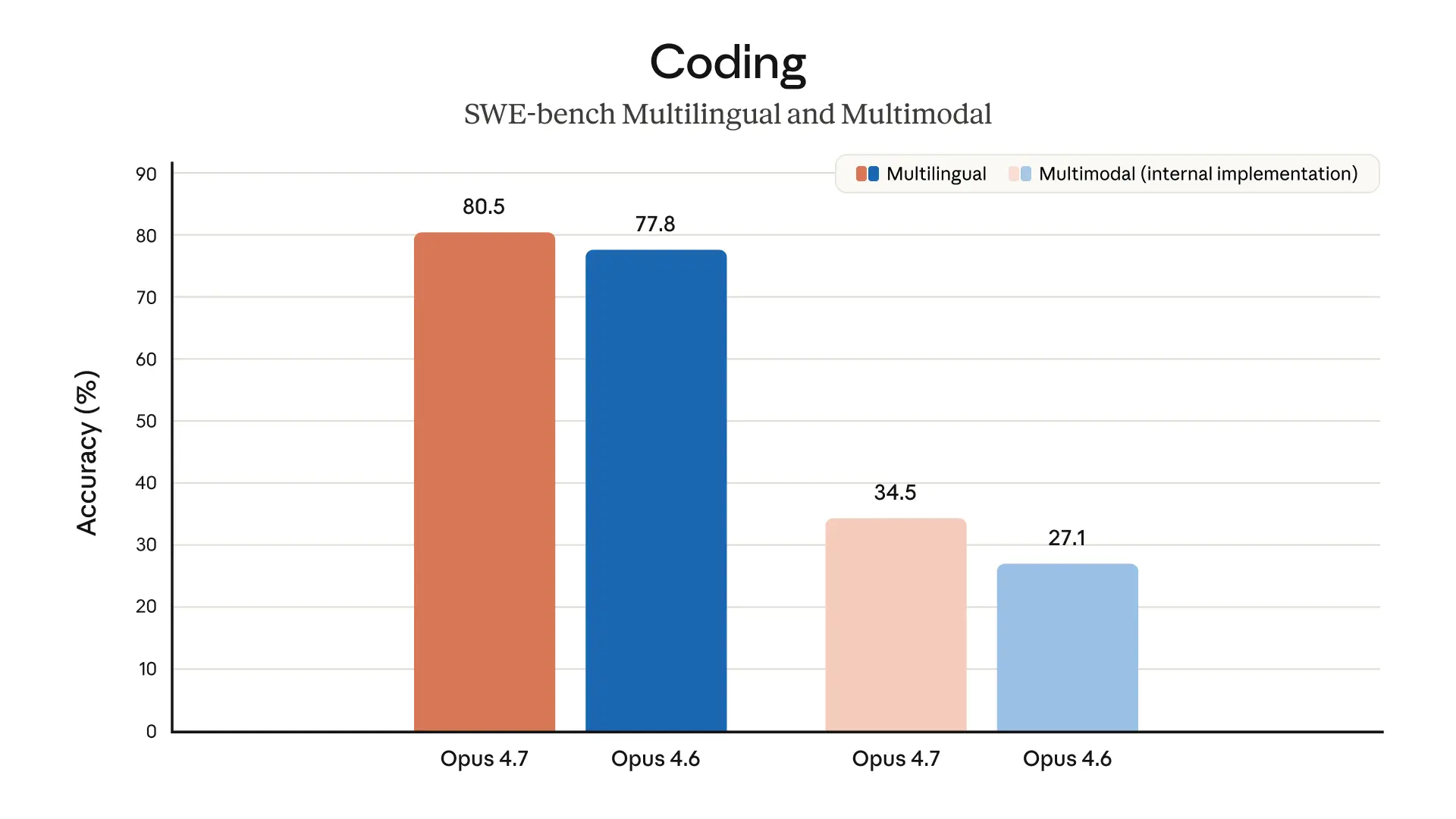

核心基准测试表现

在 2026 年的评估体系中,编码能力依然是衡量 AI 智能的关键。根据最新的官方数据及合作伙伴测评:

- SWE-bench Verified: 成绩从 80.8% 飙升至 87.6%,这意味着模型在修复真实 GitHub 问题方面已经极具竞争力。

- CursorBench: 提升至 70%(前代为 58%),展现了在集成开发环境(IDE)中的丝滑配合。

- XBOW 视觉准确度: 从 54.5% 跃升至 98.5%,这一跨越式的进步让“计算机使用”类任务(Computer Use)变得更加可靠。

四个影响深远的变革

1. 自验证行为 (Self-Verification)

Opus 4.7 引入了一个行为级的转变:模型会在报告任务完成前,主动检查自己的输出。在编程场景下,这意味着它会自发编写测试、运行并修复失败的测试。Hex 的 CTO 观察到,该模型能正确报告数据缺失,而不是提供“看似合理但错误”的反馈,这极大地降低了 AI 生成内容的幻觉风险。

2. 视觉分辨率的 3.3 倍进化

模型现在能以高达 3.75 MP 的分辨率处理图像。对于需要解析高密度截图、技术图表或扫描文档的任务,Opus 4.7 的像素坐标现在可以与屏幕坐标 1:1 映射,不再需要繁琐的缩放修正。

3. 全新的 "xhigh" 努力层级

为了应对更复杂的编程挑战,Anthropic 引入了 xhigh 努力层级。在处理复杂的 PR 回复时,CodeRabbit 报告其召回率提升了 10% 以上。开发者可以通过 API 参数显式设置:

export CLAUDE_CODE_EFFORT_LEVEL=xhigh

4. 隐藏的成本:Tokenizer 的变动

虽然每百万 Token 的单价($5/$25)保持不变,但 Opus 4.7 采用了新的分词器。这意味着对于同样的文本,生成的 Token 数量会增加 1.0x 到 1.35x。尤其是多语言文本(如中日韩文字),成本上升可能高达 35%。这是企业在迁移模型时必须评估的财务因素。

基准测试的局限性:为何分数不再代表一切?

尽管 Opus 4.7 在 SWE-bench 上表现优异,但在 Terminal-Bench 2.0(测试命令行操作能力)中,它以 69.4% 的成绩落后于 GPT-5.4 的 75.1%。同时,在 Web 研究任务(BrowseComp)中,Opus 4.7 甚至出现了小幅退步。

这揭示了 2026 年 AI 评估的一个核心矛盾:基准测试正在饱和。 当所有模型都在基准测试中获得高分时,真实生产环境中的失败率依然居高不下。Kili Technology 曾指出,单纯依赖自动化基准测试会导致“过度优化”而忽视实际场景中的鲁棒性。人类专家的评审(Human Expert Review)在今天反而比以往任何时候都更加关键,它是连接“测试高分”与“生产可用”之间的唯一桥梁。

总结:如何选择你的 AI 模型?

在 2026 年,选择模型不应只看排行榜:

- 如果你需要最强的端到端编程代理:Opus 4.7 是首选,其自验证机制能显著节省调试时间。

- 如果你的任务涉及大量命令行操作:GPT-5.4 系列目前仍保持领先。

- 如果你在意成本控制:请务必针对你的特定业务数据进行 Token 计数对比,Opus 4.7 的新分词器可能会改变你的 ROI 模型。

未来的 AI 评估将不仅仅是分数的较量,更是对模型行为稳定性、视觉精度以及成本效率的综合考量。