2026年AI演进:从“提示词工程”到“上下文工程”的深度解析

在AI飞速发展的今天,我们正处于一个关键的转折点。几年前,人们普遍担心“AI将取代工程师”;然而到了2026年,现实证明了这个观点的偏颇。AI并没有取代工程师,而是重新定义了工程师的角色。在这个过程中,曾经被奉为圭臬的“提示词工程(Prompt Engineering)”正在演变为更深层次的学科——上下文工程(Context Engineering)。

一、 角色转变:从“代码编写者”到“意图翻译官”

根据Reddit社区和Coursera的最新路线图,2026年的AI交互将更少关注编码,而更多关注于成为人类意图与机器逻辑之间的翻译官。

工程师和开发者并没有失业,而是“向上游移动”了。过去我们需要编写冗长的代码来实现功能,现在我们通过构建结构化的指令和环境来引导AI。这要求从业者具备三大核心能力:

- AI模型素养:了解不同模型(如GPT系列、Claude、Midjourney等)处理信息的差异。

- 精确沟通:能够消除歧义,撰写超精确的指令。这正是创意工作者和教育者在AI时代脱颖而出的原因。

- 迭代测试:通过不断的实验分析AI失败的原因,并持续精炼逻辑。

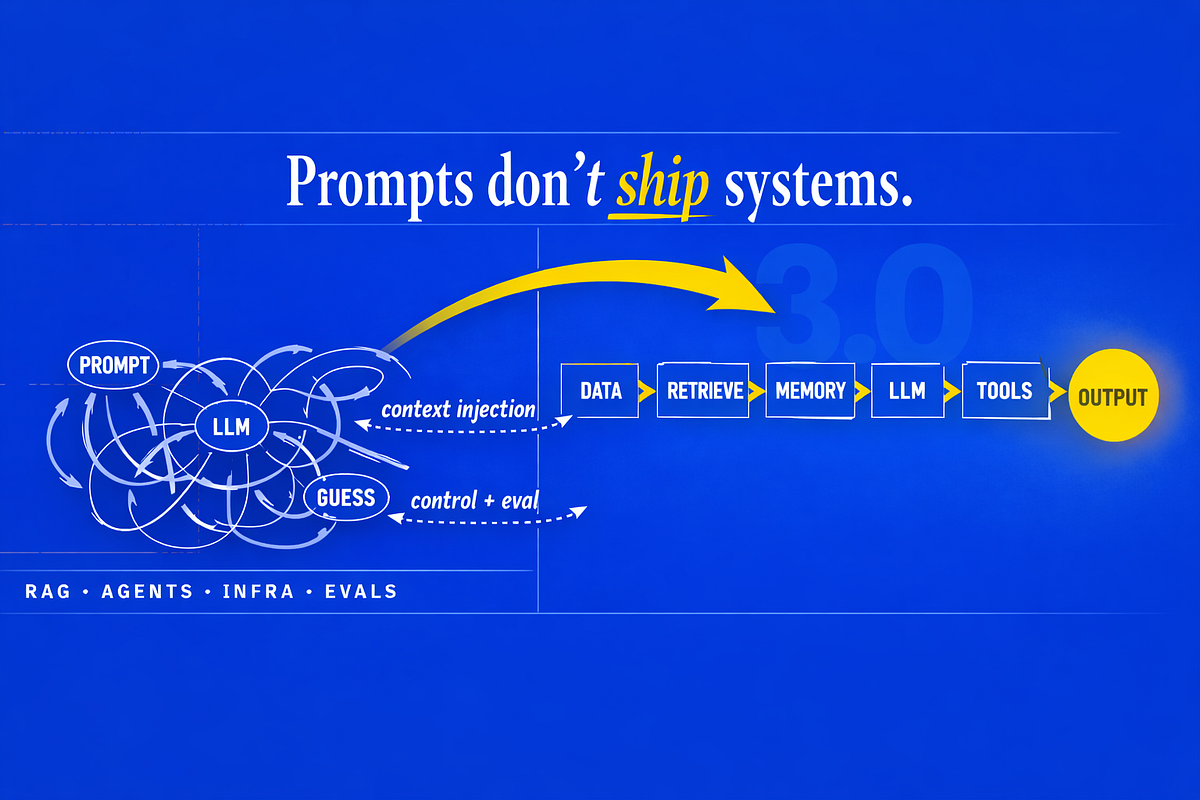

二、 提示词工程的局限性

提示词工程是指通过设计和优化输入指令来提高模型输出质量。它在处理单一、范围明确的任务(如内容生成、代码补全)时非常有效。然而,当面对企业级应用和复杂的AI智能体(AI Agents)时,其局限性开始显现:

- 静态性:提示词在编写时就固定了知识,无法动态获取实时信息。

- 单次交互:它主要解决“这一句怎么问”的问题,而不处理“整个系统知道什么”。

- 可扩展性差:随着业务逻辑变复杂,单纯靠调优提示词会导致模型忽略指令或产生幻觉。

数据显示,82%的IT领导者认为,单纯的提示词工程已不足以支撑规模化的AI应用。

三、 什么是上下文工程?

上下文工程是一个更广泛的学科,它负责设计和管理大语言模型(LLM)周围的完整信息环境。如果说提示词工程是“如何说话”,那么上下文工程就是“模型在说话前需要知道什么”。

上下文工程的核心组成:

- 检索(Retrieval):决定从矢量数据库或API中拉取哪些外部知识。

- 压缩(Compression):在不丢失关键信号的前提下,减少Token消耗。

- 状态管理(State Management):决定哪些信息在多轮对话中保留,哪些丢弃。

- 工具编排(Tool Orchestration):选择模型可以访问的工具,并管理其输入输出流。

深度对比:提示词工程 vs 上下文工程

| 维度 | 提示词工程 | 上下文工程 | | :--- | :--- | :--- | | 核心问题 | “我该如何措辞?” | “模型需要知道什么?” | | 范围 | 单次交互 | 系统级信息流 | | 知识来源 | 嵌入在指令中 | 运行时动态检索、处理 | | 失败模式 | 歧义、语气错误 | 幻觉、上下文溢出、陈旧数据 | | 企业就绪度 | 实验性、手动 | 生产级、系统化 |

四、 基础设施的缺失:上下文管理

上下文工程并非凭空产生,它依赖于底层的上下文管理(Context Management)。这是目前许多企业构建AI系统时缺失的一环。许多AI智能体之所以失败,并不是因为模型不够聪明,而是因为提供给它的上下文数据是“脏”的、过时的或零散的。

2026年的企业调研显示:

- 87% 的组织认为数据准备度是AI落地的最大障碍。

- 61% 的AI项目因为缺乏可信、可靠的数据而推迟。

为了解决这些问题,像DataHub这样的平台提出了元数据驱动的解决方案。通过统一的元数据层,AI智能体可以实时访问经过治理的数据谱系、质量信号和业务定义,从而做出更精准的决策。

五、 总结:如何备战2026?

AI的可靠性已经从“写出更好的提示词”转向了“构建更优的上下文”。对于个人和企业来说,这意味着:

- 不再迷信“万能提示词”:将精力投入到系统架构和信息流的设计中。

- 投资数据基础设施:确保你的AI系统能够访问到实时、治理良好的企业知识。

- 拥抱工具化:减少手动盲目试错,利用自动化工具进行提示词草拟和上下文约束注入。

正如一位资深开发者所言:“当AI开始自动执行任务时,工程师并没有消失,他们只是获得了一次晋升,成为了管理AI系统的建筑师。”

参考来源:Reddit r/chatforanswer, Medium Level Up Coding, DataHub State of Context Management Report 2026