超越基准测试:OpenHands 与 Agentic AI 的生产力转型之路

引言:从对话式 AI 到代理式 AI 的飞跃

进入 2026 年,人工智能的范式正在发生根本性转变。我们不再仅仅满足于能写代码或回答问题的聊天机器人,而是转向能够计划、决策、行动并在既定规则下学习的 Agentic AI(代理式 AI)。这种转变标志着从简单的“任务自动化”向“受监督的决策授权”进化。

然而,随着这种进化的深入,一个严峻的问题浮出水面:为什么在实验室基准测试中表现优异的 AI 智能体,一旦进入复杂的生产环境就会“掉链子”?

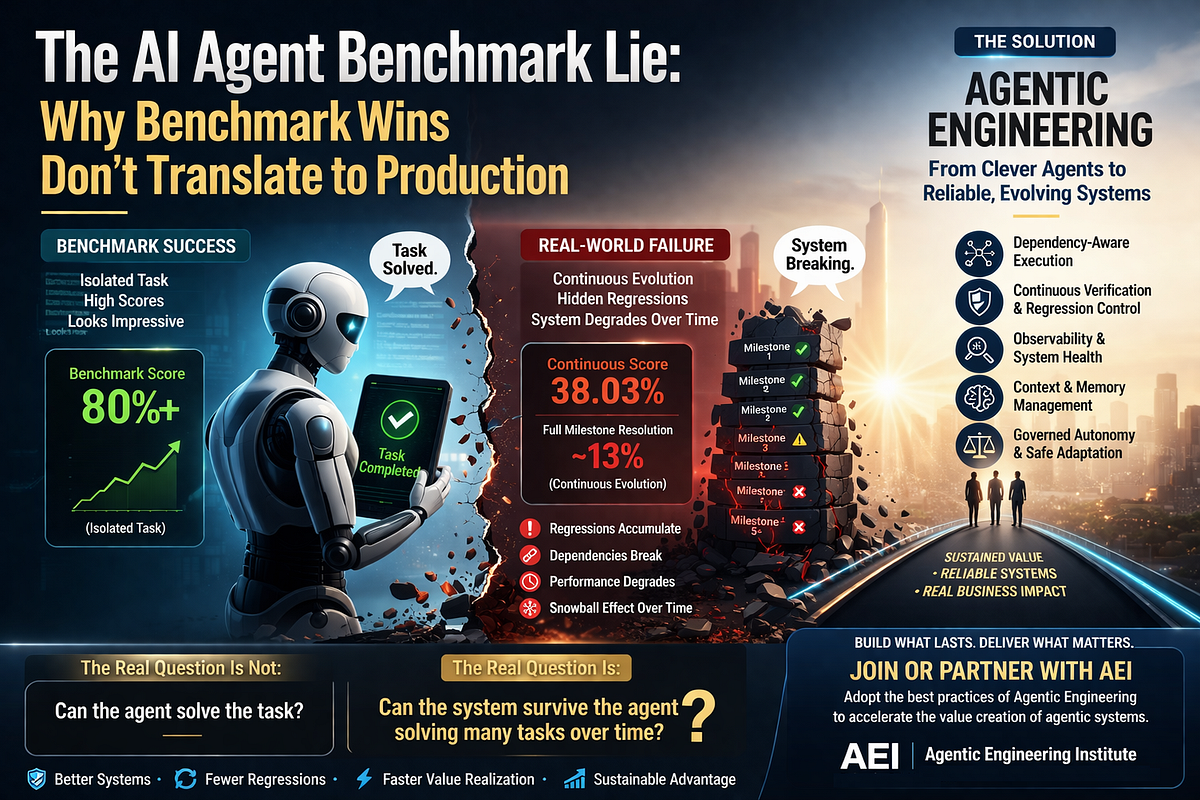

基准测试的“谎言”:任务智能 vs. 系统性能

近日,由南加州大学(USC)、斯坦福大学、普林斯顿大学以及 OpenHands 团队联合发布的一项名为“EvoClaw: Evaluating AI Agents on Continuous Software Evolution”的研究,揭示了当前 AI 智能体评估的盲点。

目前的 AI 智能体市场往往庆祝错误的指标。大多数基准测试衡量的是智能体解决单一、隔离任务的能力。然而,真实世界的软件开发是持续演进的。一个智能体可能成功修复了一个 Bug,但它是否能在一连串相互关联的代码变更中保持整个系统的健康?

EvoClaw 的惊人发现

研究数据显示,顶级智能体在处理隔离任务时可以获得超过 80% 的高分。但在持续演进的设置下,性能会骤降至 38.03%。更令人担忧的是,对于复杂里程碑的完整解析率(Full Milestone Resolution)最高仅为 13% 左右。

这就是所谓“任务智能”与“系统性能”之间的鸿沟。为了弥合这一差距,我们需要从单纯的 AI 开发转向代理工程(Agentic Engineering)。

OpenHands:引领开源智能体的新前沿

作为该领域的重要参与者,OpenHands 不仅仅在学术研究上发力,更致力于通过开源社区推动技术的实际落地。

OpenHands 正在通过定期的社区互动和透明的项目更新,构建一个健康的开发者生态。本周四(4月9日),OpenHands 将举行社区会议与开放式问答活动。本次会议将涵盖:

- 新贡献者致谢:表彰为项目做出贡献的开发者。

- 项目最新进展:分享 OpenHands 的最新技术迭代。

- 新功能演示:现场展示如何利用 OpenHands 处理复杂的工程任务。

- 未来愿景:探讨 OpenHands 在代理工程领域的下一步走向。

对于想要实时掌握 Agentic AI 前沿动态的开发者和架构师来说,这无疑是一次宝贵的交流机会。

2026 年的企业级 Agent 转型建议

对于中小企业(SMB)或大型技术团队而言,如何抓住 Agentic AI 的红利并规避基准测试的陷阱?

- 关注“持续性”而非“单点性”:评估工具时,测试其在多轮代码提交和复杂上下文下的表现,而非单纯的逻辑题解答能力。

- 拥抱开源工具:如 OpenHands 这样的项目提供了透明的机制,便于团队根据自身需求进行调整和审计。

- 建立人的参与机制(Human-in-the-loop):目前的代理仍处于从自动化向完全自主转化的过程中,建立合理的引导和审核流程至2026年依然至关重要。

结语:迈向真实的智能代理时代

Agentic AI 不再只是实验室里的演示 Demo,它正在成为提升生产力的核心引擎。虽然 EvoClaw 的研究提醒我们前方仍有挑战,但通过 OpenHands 等社区的努力,我们正在逐步掌握管理和利用这些复杂代理的艺术。

如果您对 AI 智能体的未来充满好奇,不妨参加本周四的 OpenHands 社区会议,亲自见证这场变革的脉动。

注:OpenHands 社区会议将于 UTC 时间 4月9日 16:00-17:00 举行,感兴趣的读者可前往其 LinkedIn 官方账号获取 RSVP 链接。