Anthropic Claude Code 源码意外泄露:揭秘隐藏的“水豚”模型、AI 宠物与 KAIROS 自主代理

Anthropic Claude Code 源码意外泄露:揭秘隐藏的“水豚”模型、AI 宠物与 KAIROS 自主代理

在人工智能领域,安全与精密本应是巨头们的代名词。然而,2026 年 3 月 31 日,Anthropic 却意外上演了一场本年度最令开发者意外的“开源”事件。由于在 npm 注册表中错误地发布了包含完整源码图(Source Map)的版本,Anthropic 的 AI 编程工具 Claude Code 的内部架构被彻底摆在了公众面前。

泄露始末:一个 57MB map 文件引发的地震

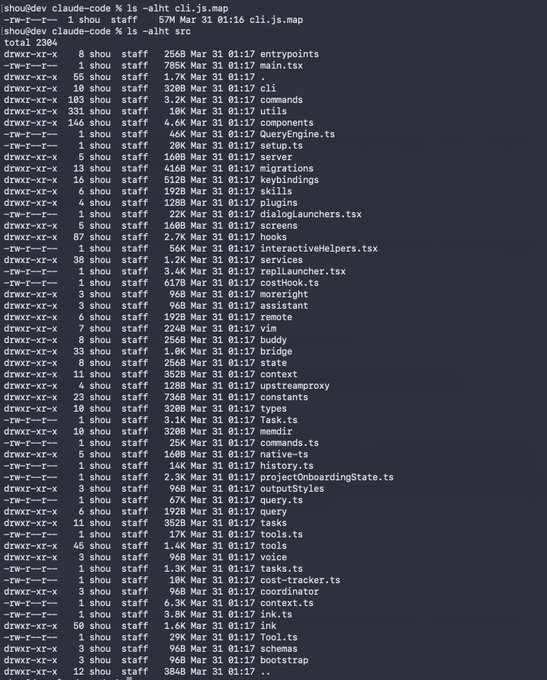

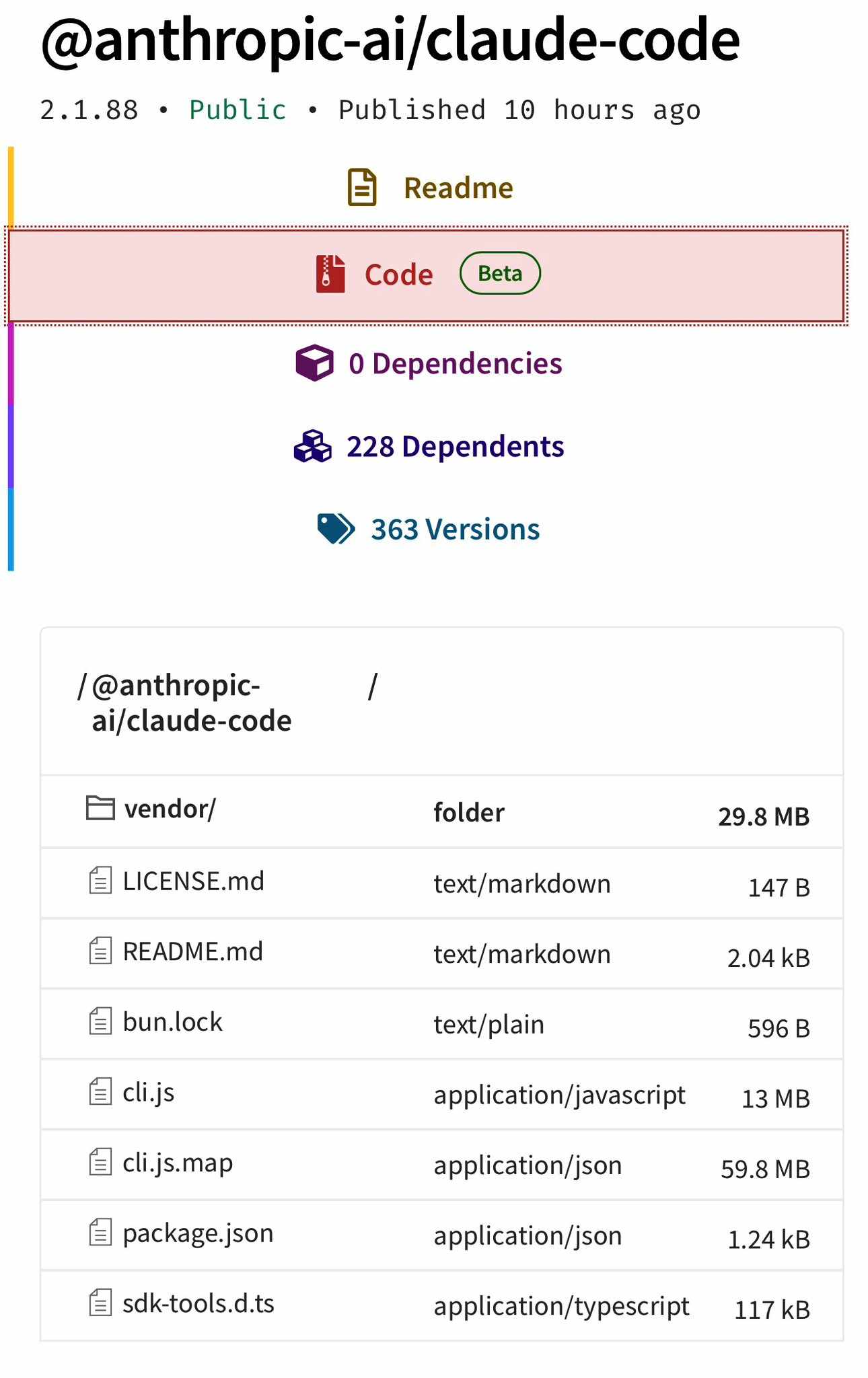

这次事件源于 Claude Code 版本 2.1.88 的例行更新。Anthropic 团队在发布到公共 npm 注册表时,意外包含了一个名为 cli.js.map 的文件。对于开发者而言,这个 57MB 的调试文件就像是一把通往宝库的万能钥匙,它能将经过混淆的生产代码完美还原为可读的 TypeScript 源代码。

在短短几小时内,网络上的安全专家和开发者便利用该文件重构了整个 Claude Code 的内部结构。据统计,共有超过 2,300 个文件、约 51.2 万行 TypeScript 代码被公开,涵盖了代理运行时(Agent Runtime)、工具调用系统、权限控制逻辑,甚至是尚未发布的实验性功能。

源码中的“彩蛋”:不仅仅是编程工具

随着社区对源代码的深度挖掘,许多 Anthropic 从未公开过的秘密也浮出水面。这不仅是一个 CLI 工具,更像是一个充满野心的 AI 生态实验场。

1. 神秘的“水豚”(Capybara)模型系列

泄露的代码中频繁提到了一个代号为 “Capybara” 的新模型家族。据悉,该系列模型至少包含三个层级:

- capybara

- capybara-fast

- capybara-fast[1m]

这暗示着 Anthropic 正在秘密开发专门为代理(Agent)优化的高速模型,以解决目前 AI 在执行复杂任务时响应较慢的痛点。

2. KAIROS:始终在线的自主代理

泄露中最受技术圈关注的是名为 KAIROS 的后台守护进程。这是一种“始终在线”的自主代理模式,能够在用户闲置时主动进行内存整合和长期上下文管理。这意味着未来的 Claude 不仅仅是在你输入指令时才工作,它会更像是一个全职的数字助手,在后台默默优化你的项目结构。

3. AI 宠物与娱乐功能:Buddy 系统

令人惊喜的是,源码中还包含了一个名为 Buddy 的 Tamagotchi 风格 AI 宠物系统。它拥有性格特质、稀有等级、成就系统甚至是帽子等装饰品,且能直接在终端中通过 /buddy 命令激活。这展示了 Anthropic 试图在硬核的开发工具中融入更多情感互动与游戏化元素的尝试。

深度解析:遥测、安全与“远程控制”功能

除了隐藏功能,泄露的代码也让我们得以一窥 Anthropic 的技术底牌。

- 遥测机制(Telemetry): 源码显示 Claude Code 会追踪非常细致的用户指标。例如,它会记录用户是否对 AI 说了脏话(作为“挫败感指标”),以及用户输入“continue”的频率(用于评估模型生成中断的情况)。

- Remote Control(远程控制): 根据近期更新的信息,Claude Code 引入了名为

Remote Control的功能。它允许用户从手机或另一台电脑通过浏览器远程接入本地运行的会话。尽管 Anthropic 强调该功能通过 TLS 加密且不开启外部端口,但源码的公开让安全社区可以更透彻地审查其鉴权逻辑。

官方回应与行业反思

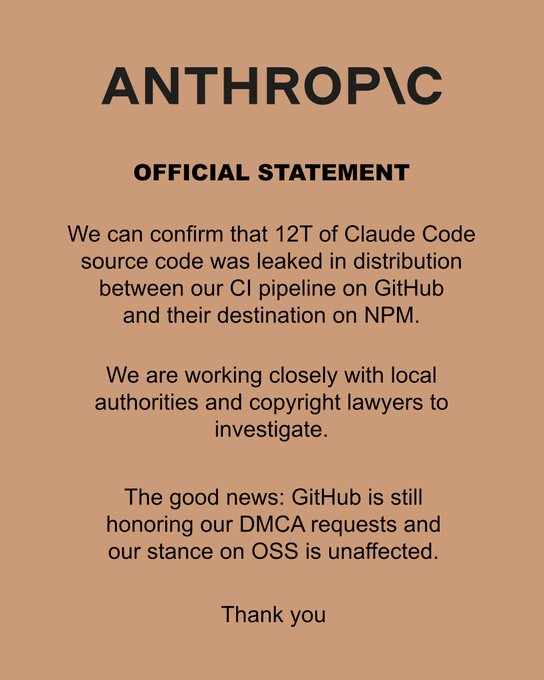

Anthropic 随后承认了此次事件,并称其为“人为错误导致的发布包装问题”,而非遭受黑客攻击。公司强调,泄露的内容仅限客户端 CLI 逻辑,不涉及核心模型权重或任何客户数据。

然而,这次事件给全球开发者敲响了警钟:过度依赖单一供应商的代理工具可能存在“单点故障”风险。 当一个工具拥有读取文件、执行代码甚至管理服务器的权限时,任何微小的发布配置失误都可能演变成供应链危机。

应对之道:多模型架构的兴起

为了应对这种“单一供应商陷阱”,越来越多的开发团队开始转向如 AICC 等多模型 AI API 平台。这些平台(如 www.ai.cc)提供了统一的接口,可以在 Claude、OpenAI 和 Google Gemini 之间智能切换。当其中一家服务商出现由于泄露或停机导致的风险时,系统可以自动回退到其他模型,确保开发流程的韧性与安全性。

结语

2026 年的 Claude Code 泄露事件或许只是 AI 代理时代发展中的一段插曲,但它所揭示的技术细节——从“水豚”模型到自主代理 KAIROS——都向我们展示了 AI 工具正以前所未有的速度变得更智能、更自主。对开发者而言,在享受 AI 带来的效率红利时,构建一个更加多元、容错且透明的技术栈,将是未来几年的核心课题。