2026年AI编程智能体大爆发:从Anthropic源码泄露到“AI同事”全面入职

2026年AI编程智能体大爆发:从Anthropic源码泄露到“AI同事”全面入职

截至2026年4月3日,人工智能在编程领域的应用已从单纯的“代码辅助”全面进化为“自主智能体”。然而,随着技术的突飞猛进,一系列关于安全、合规与人类开发者生存空间的争议也随之爆发。本周,Anthropic的史诗级源码泄露事件与社区的强烈反弹,成为了这场技术变革中的关键转折点。

Anthropic 惊魂记:51万行源码因“凌晨4点更新”泄露

本周最令人震惊的新闻莫过于 Anthropic 旗下的顶级 AI 编程智能体 Claude Code 遭受了严重的源码泄露。由于一名技术人员在凌晨 4 点进行例行软件更新时出现的人为失误,Version 2.1.88 版本意外包含了内部源代码。

此次泄露的内容极其惊人:

- 512,000 行 TypeScript 代码:暴露了 Claude Code 的记忆架构、任务编排逻辑以及 44 个尚未公开的隐藏功能。

- 底层策略泄露:竞争对手现在可以研究其“自主守护进程”(autonomous daemons)和持久化记忆系统的实现方式。

- 安全风险陡增:虽然没有用户信息或模型权重被泄露,但暴露的 npm 依赖项和 Hooks 接口可能成为黑客攻击的切入点。

尽管 Anthropic 正在全力拦截,但开源社区反应神速,已有开发者在数小时内基于泄露逻辑用 Python 和 Rust 重写了功能,并迅速在 GitHub 上获得数千颗星。这不仅让 Anthropic 的知识产权面临威胁,更引发了企业用户对 AI 软件供应链安全性的深度担忧。

“AI 同事” Junior:24/7 不下线的入职诱惑与压力

在职场端,一个名为 “Junior” 的新一代 AI 员工正在重新定义“初级程序员”的含义。Junior 每月售价 2,000 美元,能够全天候处理从起草营销方案到实时监控通信的所有任务。

不仅是初创公司,传统巨头也在强制转型。摩根大通(JPMorgan Chase) 近期宣布,将软件工程师对 AI 工具的使用情况直接与绩效考核挂钩。经理们期望开发者在 AI 的加持下展现出更高的产出率,拒绝采用 AI 工具的工程师可能面临绩效评级下调的风险。与此同时,Google 内部也推出了名为 “Agent Smith” 的工具,它能够自主访问内部文档并协助工程师完成复杂的工作流整合。

社区的反击:r/programming 宣布“全面禁令”

面对海量的 AI 生成内容和所谓的“氛围编程”(Vibe Coding),全球最大的程序员社区 Reddit 的 r/programming 频道(拥有 690 万成员)采取了极端行动:宣布在整个 4 月份暂时禁止所有关于 AI 大语言模型(LLM)的内容。

该社区版主表示,目前 LLM 的讨论严重稀释了高质量的技术交流。许多新手利用 AI 生成代码后在社区提出低质量问题,这种“生成式垃圾”正在破坏历史悠久的专家文化。此次禁令旨在进行一次社区环境的“大清扫”,区分真正的软件工程与盲目的 AI 堆砌。

识别与安全:我们如何防范“AI 脑炸”?

随着 AI 代码在企业代码库中的占比飙升,如何识别并管理这些代码成为了 CTO 们的头等大事。波士顿咨询集团(BCG)提出了 “AI 脑炸”(AI Brain Fry) 概念,描述了人类因过度监督和校对 AI 生成内容而产生的认知极限衰竭。

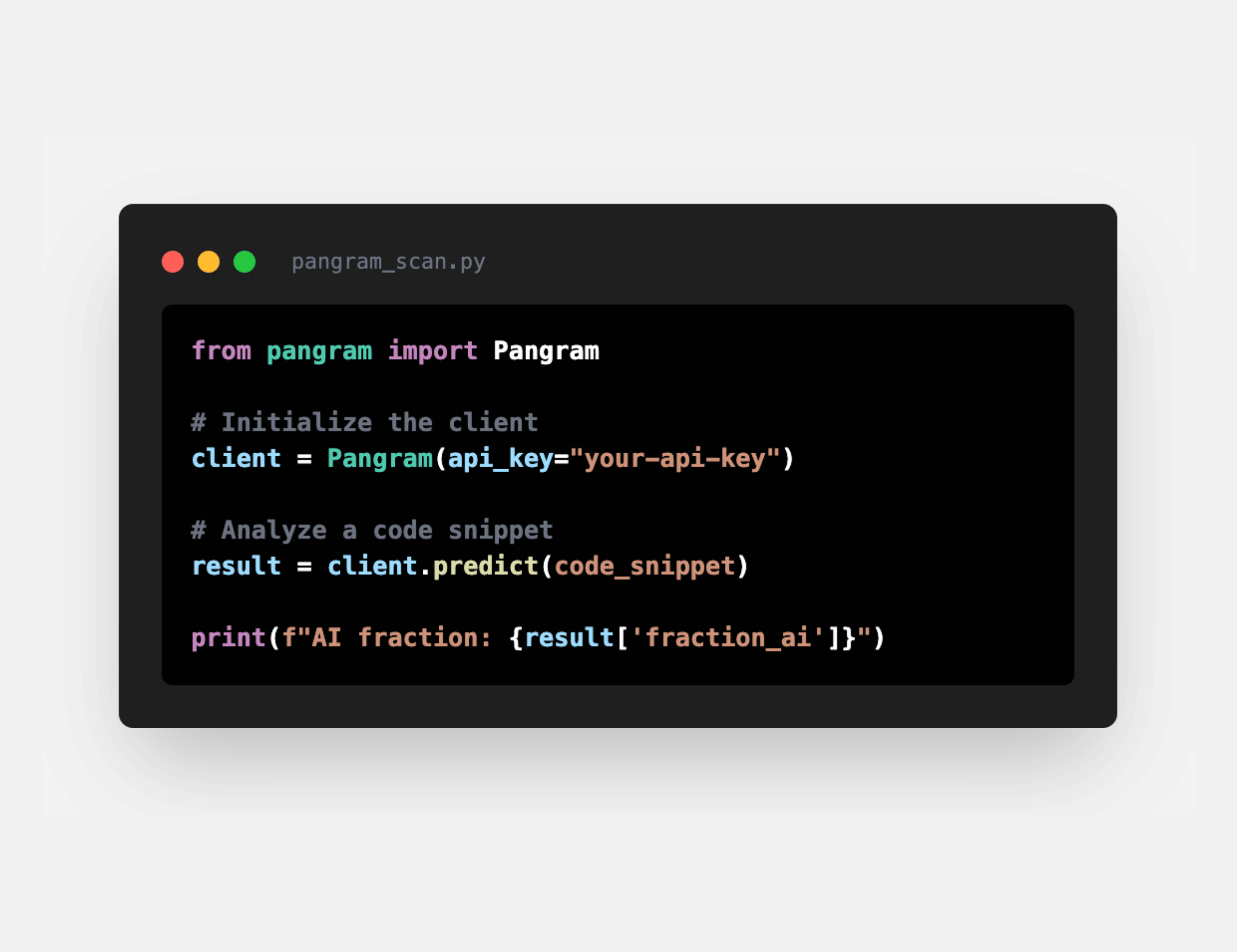

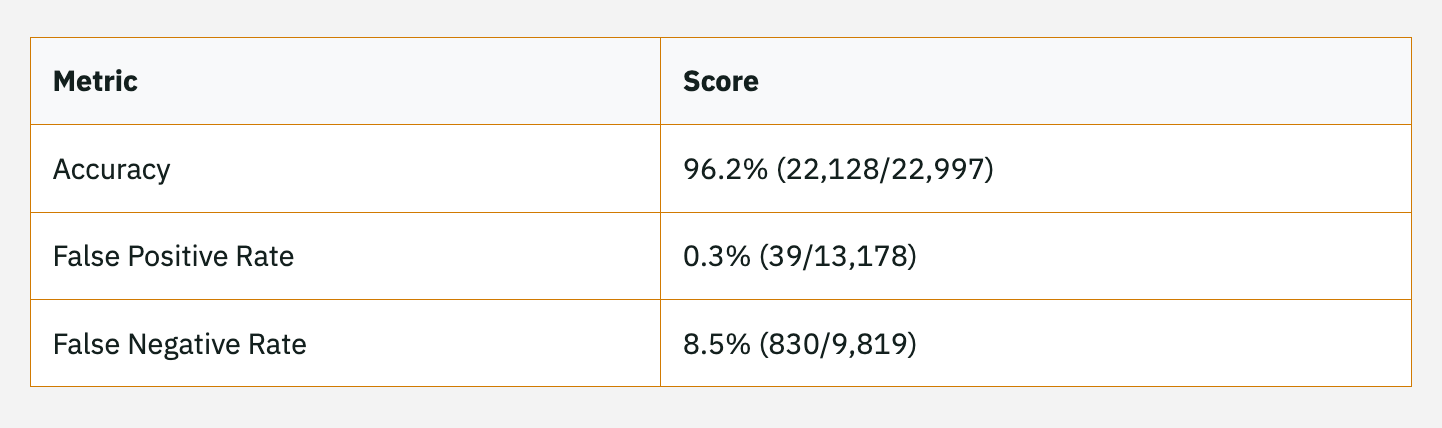

为了应对这些挑战,专业的检测工具如 Pangram Labs 正在兴起。

根据 Pangram 的研究,AI 生成的代码具有独特的“统计指纹”,例如:

- 超详细的注释风格:AI 模型(如 Claude/ChatGPT)倾向于为每一行代码编写冗长且不自然的解释。

- 结构相似性:不同开发者提交的代码如果逻辑完全一致,通常是直接复制了 LLM 的输出。

- 法律与合规:在美国,完全由 AI 生成的内容不受版权保护。如果一家初创公司的核心产品是 100% 由 Copilot 生成且未经人工修改,其知识产权保护将面临法律真空。

结语:2026 年的编程新常态

2026 年 4 月的这些事件告诉我们:AI 智能体已经不再是实验室里的玩具,而是深度嵌入生产力的双刃剑。Anthropic 的泄露提醒我们代码保护的脆弱性,而 Reddit 的禁令则映射了专业精神对效率主义的反抗。

对于开发者而言,未来的核心竞争力或许不再是编写代码的速度,而是审核 AI 代码的安全意识、理解复杂系统架构的能力,以及在“AI 脑炸”时代保持心理健康的能力。毕竟,正如那些遭遇网络攻击的初创公司所发现的,AI 能够写出代码,但它目前还无法为泄露的后果负责。