2026 AI 开发新范式:从本地优先到 MCP 协议,开启智能体新纪元

引言:AI 工具链的剧变

2026 年上半年的 AI 领域见证了一场从云端到本地、从单纯对话到主动执行的深刻变革。随着硬件厂商、开源框架和协议标准的集体发力,开发者和企业不再仅仅依赖于 OpenAI 或 Anthropic 的在线服务,而是开始构建属于自己的、私有的、具备实时能力的智能体生态系统。

Jan:重塑本地 AI 的自由与隐私

在“本地优先”的浪潮中,Jan 已成为 Claude 和 ChatGPT 的强有力开源替代品。作为一个运行在用户本地硬件上的应用生态,Jan 核心优势在于隐私与所有权。

Jan 的核心特性:

- 多平台支持:无需账户即可在 macOS、Windows 或 Linux 上运行。

- 自研基础模型:专为推理、智能体(Agents)和深度研究设计,且体积精简,足以在个人电脑上流畅运行。

- 无厂商锁定:支持在本地模型与前沿(Frontier)模型之间自由切换。

- 离线生态:通过 Jan Server,用户可以运行一个与 OpenAI 兼容的本地 API 服务器,将 AI 能力无缝接入现有工作流。

Jan 的“维修权”(Right to Repair)原则允许开发者检查、审计并修改其 AI 堆栈,这在数据敏感的今天显得尤为珍贵。

AI 编程工具:三足鼎立的 2026

在代码构建领域,市场已经分化为三条清晰的赛道:

- 终端原生智能体 (Terminal-native Agents):以 Claude Code 为代表,强调在命令行窗口直接完成复杂任务。

- AI 原生 IDE (AI-native IDEs):Cursor 继续领跑,通过深度集成 AI 提供沉浸式开发体验。

- 多编辑器插件 (Multi-editor Extensions):GitHub Copilot 和 Continue.dev 通过插件形式,横跨 VS Code 与 JetBrains 生态。

2026 年 3 月,GitHub Copilot 正式推出“智能体模式”,支持项目全局上下文感知和自动修复 PR。与此同时,市场定价也趋于统一,20 美元/月已成为行业标准,而针对重度用户的 Max 套餐(200 美元/月)也开始出现,以解决峰值期间的频率限制问题。

Nvidia GTC:硬件剧本的重写

Nvidia 在 2026 年的 GTC 大会上明确表示,自己不再仅仅是一家 GPU 公司。新推出的 Groq 3 芯片(源于其 200 亿美元的收购案)专门针对 AI 推理(Inference)进行了优化。此外,Vera CPU 架构的问世直接向 Intel 和 AMD 发起挑战,旨在处理智能体工作负载中繁重的数据编排任务。

最新的 Vera Rubin NVL72 平台承诺将推理成本降低 10 倍,同时将训练专家混合模型(MoE)所需的 GPU 数量减少 4 倍。这意味着,AI 实验室和开发者可以以更低的成本部署更强大的智能体。

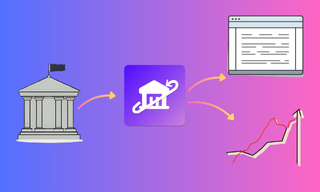

MCP 协议:打破数据孤岛的关键

如何让 AI 真正“懂”你的业务数据?Model Context Protocol (MCP) 给出了答案。随着第一届 MCP 开发者峰会的召开,该协议已在 Python 和 TypeScript 社区获得了近亿次下载量。

实战案例:使用 BankSync 与 Continue.dev 构建金融应用

通过 MCP 协议,开发者现在可以将实时银行数据直接注入 AI IDE。以 BankSync 为例,通过简单的 MCP 配置,AI 助手(如 Continue.dev)可以获得访问实时交易、余额和投资数据的能力。

配置示例:

在 .continue/mcpServers/banksync.json 中加入:

{

"mcpServers": {

"banksync": {

"url": "https://mcp.banksync.io",

"headers": { "X-API-Key": "your_api_key" }

}

}

}

这种集成让 AI 能够理解真实的财务数据结构,从而在编写 ETL 脚本、构建预算应用或生成测试数据时,提供极其精准的代码建议。

总结:迈向智能体时代

从 Jan 的本地化运行,到 Nvidia 推理芯片的进化,再到 MCP 协议的标准化,2026 年的 AI 景观已经完成了从“玩具”到“工具”的蜕变。开发者现在拥有了前所未有的选择权:你可以选择在云端利用 Vera Rubin 平台的澎湃算力,也可以选择在本地通过 Jan.ai 守护每一字节的数据隐私。

无论路径如何,Agentic AI(智能体化 AI) 结合 标准化协议 都将是未来十年的核心主题。