开发者的“黄金搭档”:揭秘 AI 助手与远程结对编程的未来

开发者的“黄金搭档”:揭秘 AI 助手与远程结对编程的未来

在软件开发的历史长河中,协作模式的演进始终是提升生产力的核心。今天,我们正站在一个新的十字路口:一方面是 GitHub Copilot 等 AI 原生助手的崛起,另一方面是 NVIDIA RTX 驱动的本地高性能 AI 模型的爆发,以及像 Hopp 这样致力于解决远程协作痛点的创新工具。本文将带您深入探讨这些技术如何交织,构建出未来的开发生态。

1. IDE 中的 GitHub Copilot:永远在线的 AI 结对程序员

对于现代开发者来说,IDE 是他们花费时间最多的地方。GitHub Copilot 的出现,将“结对编程”的概念带入了一个全新的维度。它不再仅仅是一个简单的代码补全工具,而是进化成为了一个“永远在你身边”的 AI 伙伴。

正如 Vineet Sharma 所指出的,GitHub Copilot 在 IDE(如 VS Code、JetBrains)中的深度集成,为开发者提供了实时代码建议、Copilot Chat 对话式解决问题以及跨文件系统的上下文感知。这种集成让开发者能够保持在“心流状态”,无需频繁切换窗口去查找文档或 Stack Overflow。

2. NVIDIA 与 Google Gemma 4:本地 AI 的算力革命

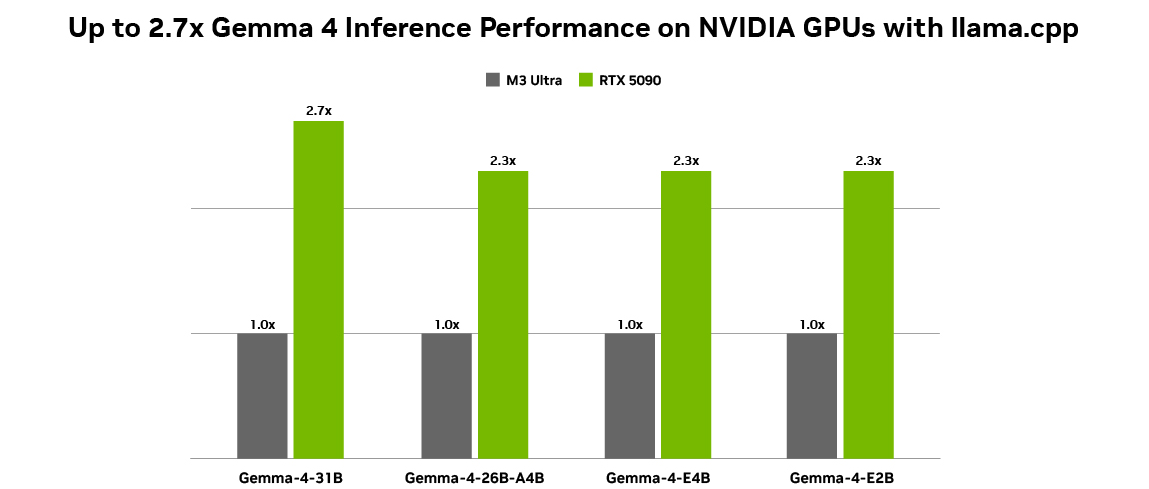

虽然云端 AI 极大地方便了开发,但本地 AI 执行正成为新趋势。Google 最新的 Gemma 4 系列模型正是这一趋势的佼佼者。通过与 NVIDIA 的深度合作,Gemma 4 在 RTX GPU 上实现了惊人的性能提升。

Gemma 4 的核心优势:

- 全能模型:支持推理、代码生成、多模态交互(视觉、视频、音频)以及多达 35 种以上的语言。

- 极低延迟:在 NVIDIA GeForce RTX 5090 等硬件上,通过 Tensor Core 加速,Gemma 4 能以毫秒级的延迟响应,这对于需要即时反馈的代码助手至关重要。

- 隐私与安全:模型完全在本地运行,意味着开发者的敏感代码资产无需上传至云端即可获得 AI 的加持。

3. 人类协作的回归:攻克远程结对编程的“最后一百米”

尽管 AI 极其强大,但复杂的架构决策和深度业务逻辑依然需要人类开发者的协作。然而,传统的远程协作工具(如 Zoom 或 Slack)在编程场景下往往显得力不从心。Hopp 的创始人 Costa Alexoglou 指出了当前远程结对编程的“三座大山”:

- 画质模糊:常规视频会议软件为动态画面优化,但在展示代码细小字符时经常失真。

- 导航地狱:缺乏有效的远程控制,导致沟通成本极高(“请往上滚动三行,不,再往左一点”)。

- 上下文缺失:现有的 IDE 插件(如 Live Share)往往局限于编辑器,无法共享终端、数据库面板或浏览器控制台。

为了解决这些问题,Hopp 采用了 Rust 和 Tauri 技术栈,将延迟压低到了 100 毫秒 以下。这个数字是人类感知“流畅控制”的临界点。通过 WebRTC 技术和低级别的系统 API 调用,Hopp 实现了高清的代码流传输和近乎原生的远程控制体验。

4. AI 与人类:是竞争还是共生?

一个普遍的疑问是:既然有了强大的 AI 助手,人类之间的结对编程是否已成过往?

事实恰恰相反。Atlassian 的调查显示,工程师只有约 16% 的时间在纯粹编写代码,剩下的 84% 时间花在架构审查、调试、会议和新人入职上。AI 处理了重复性的语法和模板代码(那 16%),而人类开发者则利用像 Hopp 这样的工具,在更高层次的策略设计上进行协作。

这种“AI 辅助 + 人类驱动”的模式可以显著缩短项目周期。正如 Alexoglou 提到的一个案例:通过高效的结对编程,一个原本预计一年的项目在四五个月内就顺利交付,效率提升了一倍以上。

总结:构建属于你的未来开发套件

未来的开发者工作站将是高度智能且无缝协作的:

- IDE 层:通过 GitHub Copilot 获取实时的 AI 指导。

- 硬件层:利用 NVIDIA RTX 的本地算力运行 Gemma 4 等大模型,保障隐私与速度。

- 协作层:使用 Hopp 等低延迟工具,与全球的队友进行无损的“面对面”编程。

无论你是资深架构师还是编程新手,拥抱这些工具将不仅仅是效率的提升,更是开发体验的一次飞跃。现在就开始探索这些“黄金搭档”,释放你的创造力吧!